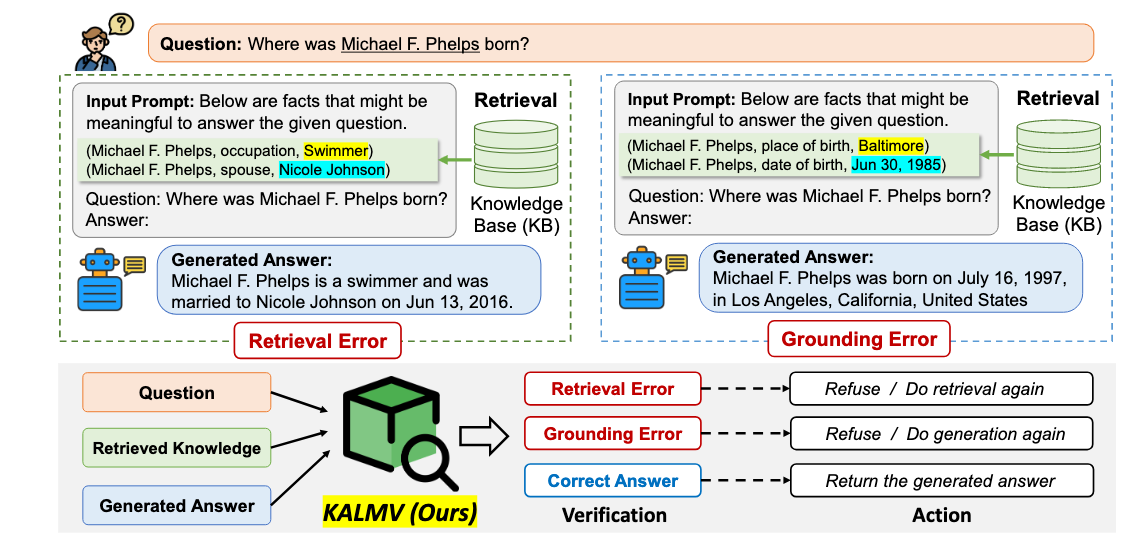

QA 태스크에서 LLM은 질문에 대해 잘못 답변(Hallucination)할 수 있고, 이를 완화하기 위해 질문과 연관된 문서를 찾아 증강(augment)하는 Retrieval-Augmented Generation 기법이 등장하였다.

그런데 이 RAG는 두 가지 난관이 있는데, 먼저 질문과 연관된 문서를 찾지 못하는 에러가 발생할 수 있고, 적절한 문서를 찾아왔지만 이를 제대로 반영하지 못하는 에러가 발생할 수 있다.1

Retrieval Error

Information Retrieval의 문제. 펠프스가 어디서 태어났냐고 물었는데 직업과 아내에 대한 정보를 가져온다면 Retrieval Error라 할 수 있다.

Grounding Error

Retrieval된 문서를 반영하지 못하는 문제. 진짜 “Hallucination"이라 할 수 있다. 펠프스가 발티모어에서 태어났다는 정보를 올바르게 가져왔는데도 LA에서 태어났다고 답변한다면 Grounding Error이다.

사실 실무적으로는 이런 종류의 Grounding Error 보다는 Context에서 어느 부분이 질문과 관련 있는 정보인지 몰라서 생기는 Grounding Error가 더 많은 것 같음.

Reference

J. Baek, S. Jeong, M. Kang, J. C. Park, and S. J. Hwang, “Knowledge-Augmented Language Model Verification.” arXiv, Oct. 19, 2023. Accessed: Oct. 20, 2023. [Online]. Available: http://arxiv.org/abs/2310.12836 ↩︎